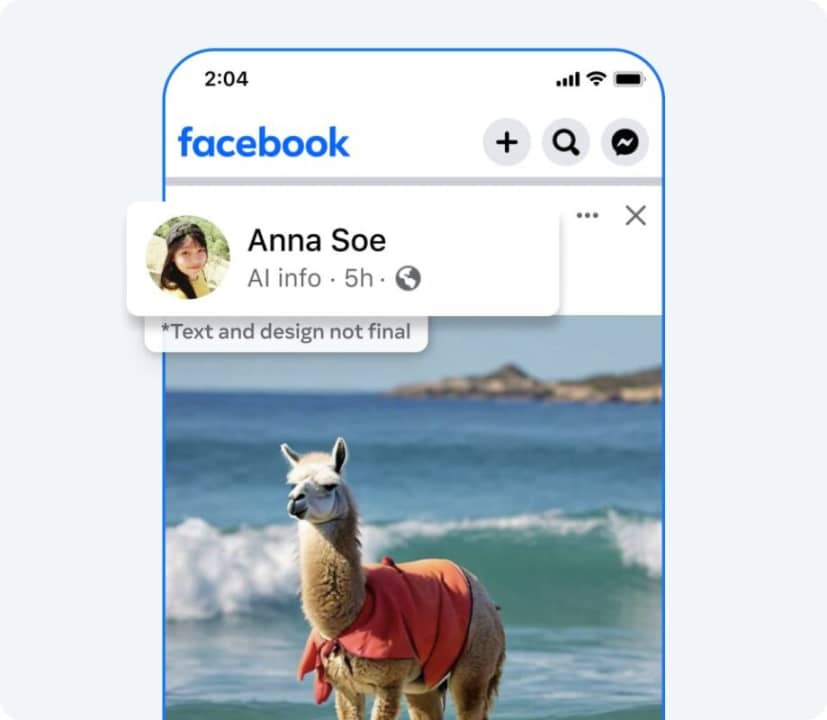

Con el uso de la IA generativa en aumento, Meta está trabajando para establecer nuevas normas en torno a la divulgación de la inteligencia artificial en sus apps. Las nuevas políticas pondrán más responsabilidad en los usuarios a la hora de declarar el uso de la IA en su contenido y establecen nuevos sistemas para detectar el uso de la IA a través de medios técnicos.

“Estamos creando herramientas líderes en el sector capaces de identificar marcadores invisibles a escala -en concreto, la información “generada por IA” de las normas técnicas C2PA e IPTC- para poder etiquetar imágenes de Google, OpenAI, Microsoft, Adobe, Midjourney y Shutterstock a medida que ponen en marcha sus planes para añadir metadatos a las imágenes creadas por sus herramientas”, dice Nick Clegg, presidente de asuntos globales de Meta, en una entrada de blog.

En teoría, estas medidas técnicas de detección permitirán a Meta y a otras plataformas etiquetar los contenidos creados con IA generativa allí donde aparezcan con el fin de que todos los usuarios estén mejor informados sobre los contenidos creados por una inteligencia artificial.

Entre otras cosas, las nuevas medidas ayudarán a reducir la difusión de desinformación creada con IA (textos, imágenes, vídeos o audios), lo que podría impedir (o dificultar) que situaciones como la que vivió la cantante Taylor Swift vuelvan a repetirse.