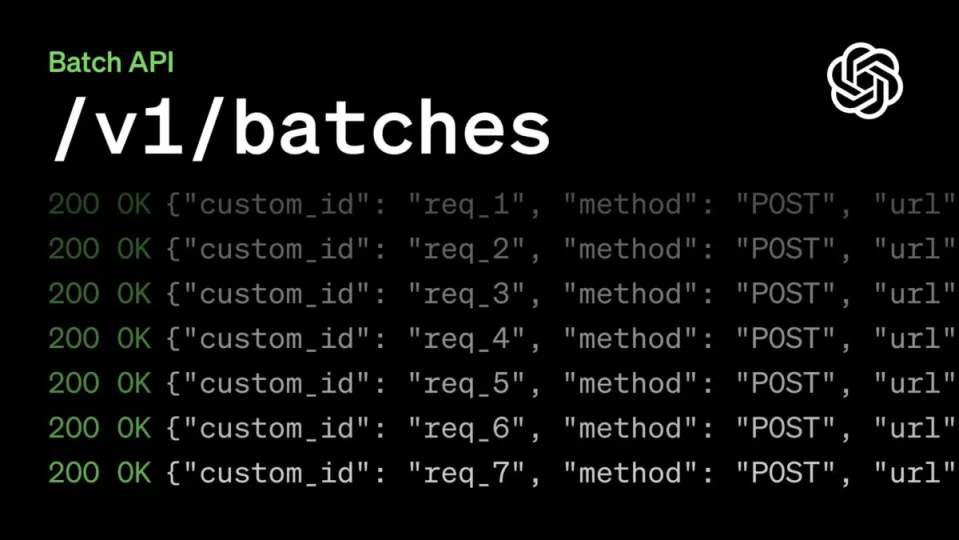

OpenAI ha lanzado la API Batch, una innovadora solución destinada a optimizar la eficiencia en el manejo de tareas asíncronas, ofreciendo a los desarrolladores una nueva forma de interactuar con los modelos de aprendizaje automático de la empresa. Esta nueva API promete reducciones significativas de costes, mayores límites de velocidad y un flujo de trabajo más ágil.

La nueva API de OpenAI es compatible con una amplia gama de modelos de IA de la compañía, incluyendo varias iteraciones de GPT-3.5 y GPT-4, lo que permite a los desarrolladores seleccionar el más adecuado para sus necesidades, así como enviar solicitudes en lotes cargando un único archivo que contiene múltiples tareas, que se procesan de forma asíncrona en segundo plano sin necesidad de interactuar en tiempo real. Los resultados se entregan en un plazo de 24 horas, lo que facilita la gestión y predicción de las cargas de trabajo.

Entre sus principales ventajas se incluyen una mayor rentabilidad (un 50% de descuento en comparación con otras API síncronas), límites de tarifa más elevados para procesar más tareas simultáneamente y capacidad de gestión de archivos, admitiendo formatos JSONL y archivos de hasta 100 GB.

La API Batch de OpenAI ofrece transparencia en los plazos de procesamiento, permitiendo a los desarrolladores hacer un seguimiento del estado de sus trabajos. Aunque ofrece numerosas ventajas, hay que tener en cuenta varias cuestiones, como la falta de compatibilidad con el streaming, una ventana de procesamiento fija de 24 horas y la retención de datos, que no es cero.

En un contexto donde cada vez más empresas integran la IA en sus operaciones, herramientas como la nueva API Batch son de inmensa utilidad para satisfacer las demandas futuras. Aunque tiene algunos inconvenientes, esta API representa un paso adelante en el procesamiento de tareas asíncronas, permitiendo el procesamiento masivo de tareas a un coste reducido y con mayor eficiencia.