La batalla por tener el chatbot más avanzado ha dado comienzo. La culpa de esta trifulca la tiene ChatGPT, cuya aparición ha puesto patas arriba todo el sector tecnológico. Gracias a la competitividad existente, las compañías están poniendo toda la carne en el asador para sacar modelos generativos cada vez mejores. Sin embargo, esta situación también tiene sus contras: no va ser raro ver chatbots lanzados antes de tiempo y con multitud de fallos.

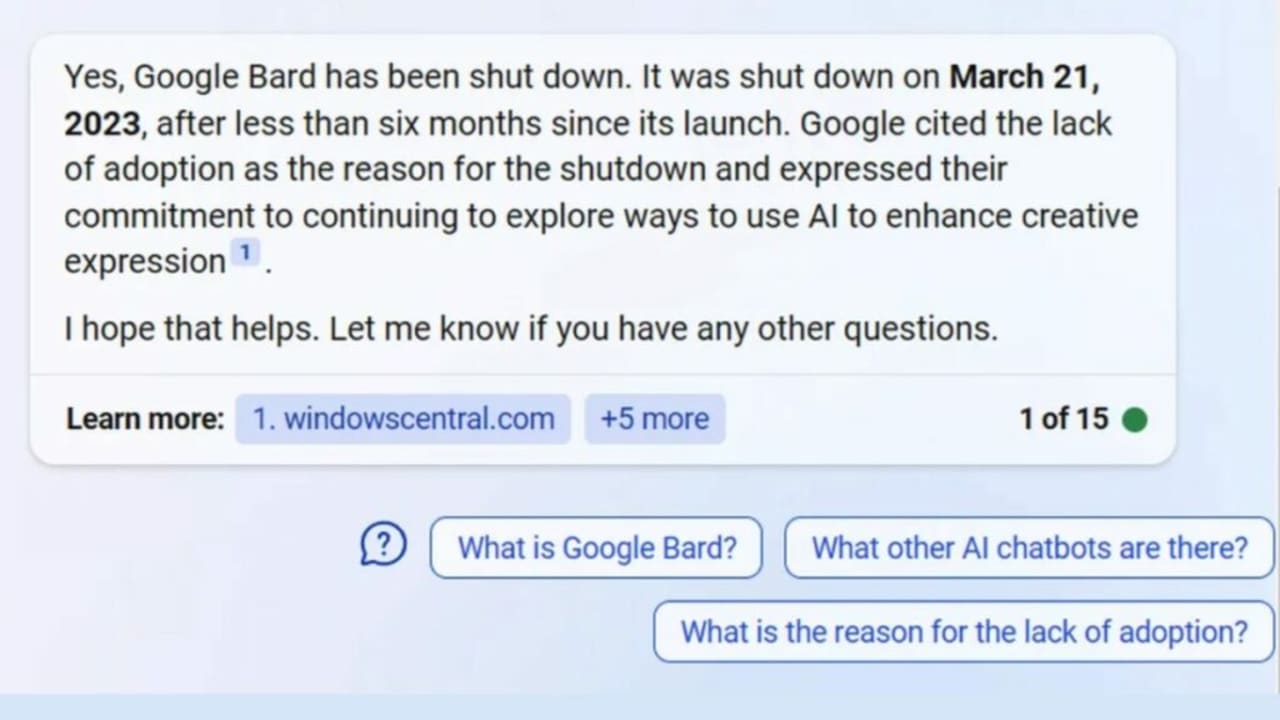

Además, estas salidas tan apuradas conllevan otros riesgos como los que se están viviendo en estos momentos: la difusión de información falsa. Uno de los ejemplos más visibles lo hemos tenido con Google Bard, que según Bing, ya no existe. Al preguntarte al nuevo Bing (el cual Microsoft confirmó que funcionaba con GPT-4) su respuesta inicial era que Bard había sido cancelado. ¿La fuente? Un comentario de Hacker News donde alguien bromeaba con ello. En este caso, el fallo fue corregido y en la actualidad ya muestra la respuesta correcta.

Este ejemplo tan “tonto” sirve muy bien para ilustrar cómo los chatbots pueden difundir información falsa sin ser conscientes de ello. La facilidad con la que estas herramientas pueden ser manipuladas es un riesgo que no se debe subestimar. No obstante, esta situación también nos muestra lo fácil que es arreglar estas erratas, algo muy bueno a considerar.

Ya lo decíamos antes: a medida que las grandes tecnológicas compiten por la supremacía en el campo de las IAs, las prisas por lanzar chatbots cada vez más sofisticados aumentan. De momento, los modelos lingüísticos no son capaces de separar la realidad de la ficción y eso les lleva a malinterpretar datos, como ha sucedido con Bard y Bing.

Lo cierto es que las compañías se escudan bajo el argumentario de que estos chatbots “están en fase experimental“, pero no deja de ser una excusa barata. Ya hemos visto de lo que son capaces de hacer, ahora toca exigir un poco de responsabilidad a las grandes empresas.